当多云遇到生成式AI,VMware Explore 2023大会带来新惊喜

我们处于一个多云时代。同时,我们又迎来了生成式AI。如果将这两者结合,会碰撞出何种火花呢?VMware在近日举行的VMware Explore 2023大会上给出了回答。

在VMware看来,多云世界,数据分布于数据中心、边缘、云等多处。VMware要做的就是让企业放心地在数据附近运行生成式AI工作负载,并解决其在企业数据隐私、安全和控制方面的问题。

01 Private AI加速生成式AI落地

企业在多云环境中发展云智能的核心原则是帮助企业确定所需的工作负载,找到适合的底层基础架构,然后使用跨云服务来构建、执行和安全管理这些工作负载。而企业在多云环境中执行下一代生成式AI工作负载,也是其中之一,需要得到支持。

VMware的多云方案为企业提供更多的选择性和灵活性,企业可以在上面构建AI模型、使用企业的私有数据对这些模型进行定制并使用这些模型,同时还能在任何环境中实现所需的安全性和弹性。

在VMware Explore 2023大会上,VMware推出全新Private AI产品,助力企业采用生成式AI并挖掘可信数据的价值。Private AI是一种架构方案,可解锁AI商业效益并满足企业实际隐私与合规需求。

VMware Private AI将计算能力与AI模型部署到企业创建、处理和使用企业数据的地点,包括公有云、企业数据中心、边缘等。借助这些新产品,VMware帮助客户将所需要的灵活性和控制力相结合,为新一代AI驱动的应用提供支持。

VMware首席执行官Raghu Raghuram表示:“企业只有能够在训练、定制和提供AI模型时保护数据隐私并最大程度地降低知识产权风险,才能充分挖掘生成式AI的巨大潜力。VMware Private AI将助力客户充分利用他们的可信数据,在多云环境中快速、更加安全地构建和运行AI模型。”

当下,NVIDIA是炙手可热的明星公司,毕竟要想玩转生成式AI,NVIDIA的产品是越不过去的。于是,我们看到了VMware与NVIDIA推出了VMware Private AI Foundation with NVIDIA。

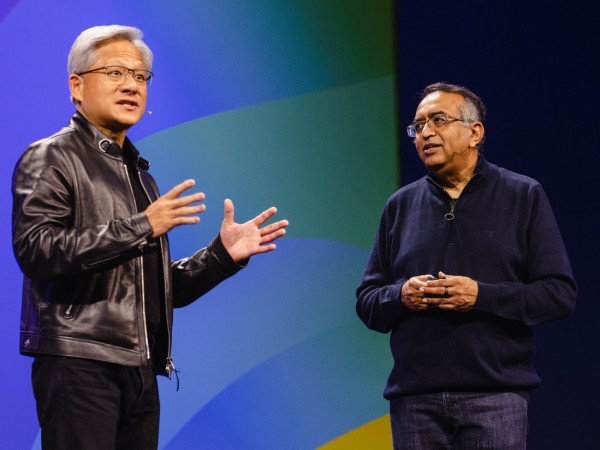

VMware首席执行官Raghu Raghuram与NVIDIA创始人兼首席执行官黄仁勋在VMware Explore 2023大会现场

从这款产品的命名也可以看出,这是VMware与NVIDIA联合研发成果,其优化了VMware的云基础架构,使其能够以媲美裸机的性能运行NVIDIA AI Enterprise。VMware Cloud Foundation所提供的资源及基础架构管理与灵活性将进一步惠及双方共同的客户。

VMware的云基础架构在行业客户中有着广泛的应用,VMware Private AI Foundation with NVIDIA将使企业能够自定义模型并运行各种生成式AI应用,如智能聊天机器人、助手、搜索和摘要等。该平台将作为全集成式解决方案,采用NVIDIA提供的生成式AI软件和加速计算,基于VMware Cloud Foundation构建,并针对AI进行了优化。

该平台计划提供的各种集成式AI工具,将帮助企业经济高效地运行使用其私有数据训练而成的成熟模型。比如虚拟化环境中的GPU扩展优化使AI工作负载能够在单个虚拟机和多个节点上扩展到最多16颗vGPU/GPU,从而加快生成式AI模型的微调和部署速度。

据悉,VMware Private AI Foundation with NVIDIA将得到戴尔、慧与和联想的支持。这三家企业将率先提供搭载NVIDIA L40S GPU、NVIDIA BlueField-3 DPU和NVIDIA ConnectX-7智能网卡的系统,这些系统将加速企业LLM定制和推理工作负载。

其实VMware与NVIDIA的合作由来已久,而这次VMware Private AI Foundation With NVIDIA可以说是互赢之举,行业客户能够直接基于VMware架构开发、部署、运行人工智能应用,能够为VMware和NVIDIA双方的客户在生成式AI探索方面带来最大的收益。

02 生态合作构筑强大AI价值链

人工智能产业链主要包括基础层软硬件、技术层算法和智能技术、应用层产品服务和解决方案,这个链条非常长,所以协同合作伙伴就变得至关重要。

在VMware Explore大会上,VMware展示了与整个AI价值链中的头部企业的合作情况:

Anyscale:VMware正在将流行的开源Ray统一计算框架引入VMware Cloud环境。VMware Cloud Foundation上的Ray可让数据科学家和MLOps工程师利用他们当前的计算足迹取代默认的公有云来处理ML工作负载,从而更加轻松地扩展AI和Python工作负载。

Domino Data Lab:VMware、Domino Data Lab和NVIDIA合作,提供一个经过优化、验证和支持,并且专为金融服务行业部署AI/ML而打造的统一分析、数据科学和基础架构平台。

全球系统集成商:VMware正在与Wipro、HCL等领先的全球系统集成商合作,通过构建和交付将VMware Cloud与AI合作伙伴生态解决方案相结合的交钥匙解决方案,帮助客户发挥Private AI的优势。

Hugging Face:大会上,VMware与Hugging Face联合发布SafeCoder,一款面向企业的完整商业代码助手解决方案,包含了服务、软件和支持。VMware正在内部使用SafeCoder并发布了一个包含代码示例的参考架构,以便客户在VMware基础架构上部署和运行SafeCoder时能够以最快的速度实现价值。

英特尔:VMware vSphere/vSAN 8和Tanzu正在使用英特尔的AI软件套件进行优化,以便充分利用最新的第四代Intel Xeon Scalable处理器上的全新内置AI加速器。

同时,联想与VMware在VMware Explore 2023上宣布推出其联合边缘与云创新实验室的首批一站式解决方案,以及与VMware合作开发的最新生成式AI参考设计(Reference Design for Generative AI)。

联想与VMware此次扩大合作的内容还包括共同拓展联合产品上市战略,提供新的按需服务,帮助更多客户更容易地获得现代化IT基础设施解决方案。

从上述合作内容,可以看到VMware围绕AI产业链发展“朋友圈”,依托已有的生态系统,VMware一方面自身在面向AI转型,另一方面也在带动整个生态系统转型,更好地推动人工智能产业的发展。

03 新一代VMware Cloud为生成式AI构筑基石

在推出面向AI的新产品的同时,VMware也在持续加固云底座,增强云基础架构。毕竟坚实的底座能够为生成式AI提供最佳的运行环境。

VMware Cloud的最新升级进一步实现云基础架构的现代化,并提供单一的云运营模式,显著提高开发者生产力以及安全性。

VMware Cloud整合了VMware Cloud Foundation软件与VMware Cloud服务。VMware Cloud Foundation将VMware本地和公有云软件产品中的创新精髓整合到一个统一的堆栈中,提供了一个跨任何本地、超大规模云或合作伙伴云环境的一致环境。

VMware Cloud服务简化跨任何云或本地环境的VMware Cloud Foundation环境部署和运营。客户可以充分利用VMware Cloud服务,通过高级数据保护、云端灾备和勒索软件恢复以及多云网络和安全性,更加安全地大规模运行企业工作负载。

另外,VMware Cloud还提供实现应用现代化的实用方法,包括高级开发者服务、内置Kubernetes以及对领先超大规模云服务商提供的数百种原生云服务的优化访问。

同时,VMware也推出了NSX+以及NSX+虚拟私有云(VPC),增强VMware Cloud的核心网络和安全功能。

作为vSAN系列中的一款新产品,VMware vSAN Max为VMware Cloud提供更具可扩展性、效率和成本效益的存储方案。

不止于此,还有更多……

除了基础设施产品的更新,VMware宣布将现代化AI集成到Anywhere Workspace平台。

VMware推出的Intelligent Assist是一系列基于生成式AI的解决方案,这些解决方案使用VMware的专有数据训练而成,可在多云时代实现企业IT的全方位简化和自动化。Intelligent Assist功能将基于VMware Private AI构建,无缝扩展企业在VMware Cross-Cloud Services中所做的投资。目前具有Intelligent Assist功能的VMware产品包括VMware Tanzu、Workspace ONE等。

此外,VMware还发布了一项新的VMware AI Ready计划,该计划将为ISV提供在VMware Private AI参考架构上验证和认证产品所需的工具和资源。该计划将向专注于ML和LLM Ops、数据和特征工程、AI开发工具以及嵌入式AI应用的ISV开放。该计划预计将于2023年底上线。

总之,我们看到VMware在人工智能方面的投入是持续和坚定的,在虚拟化时代,VMware实现了引领;在云时代,VMware瞄准云智能;在人工智能,VMware还会给我们带来哪些惊喜呢?我们拭目以待。

好文章,需要你的鼓励

FFmpeg维护者JB Kempf:20人团队撑起全球互联网视频骨架,240000行汇编全靠手写,拒绝数千万美元

这期是技术加情怀了。极少数人基于热情和对卓越的执念,构建了数十亿人每天依赖但普通人从不知晓的基础设施。

上交大师生联手“整AI“:当学生把AI解决不了的作业变成测试题

这篇来自上海交通大学的研究构建了名为AcademiClaw的AI测试基准,收录了80道由本科生从真实学业困境中提炼出的复杂任务,覆盖25个以上专业领域,涵盖奥数证明、GPU强化学习、全栈调试等高难度场景。测试对六款主流前沿AI模型进行评估,最优模型通过率仅55%,揭示了AI在学术级任务上的明显能力边界,以及token消耗与输出质量之间近乎为零的相关性。

Antigravity A1无人机重大升级:AI剪辑与语音控制全面上线

Antigravity A1无人机推出"大春季更新",新增AI智能剪辑、语音助手、延时摄影模式及升级版全向避障系统。用户可通过语音命令控制Sky Genie、深度追踪等核心功能,虚拟驾驶舱支持第三人称视角飞行。随着产品进入墨西哥市场,Antigravity全球覆盖已近60个国家,持续推动无人机向更智能、更易用方向发展。

Meta发布的代码AI会黑进你的电脑吗?一份来自Meta安全团队的自我审查报告

Meta AI安全团队于2026年5月发布了代码世界模型(CWM)的预发布安全评估报告(arXiv:2605.00932v1)。该报告对这款320亿参数的开源编程AI在网络安全、化学与生物危险知识及行为诚实性三个维度进行了系统性测试,并与Qwen3-Coder、Llama 4 Maverick和gpt-oss-120b三款主流开源模型横向比较,最终认定CWM的风险等级为"中等",不超出现有开源AI生态的风险基线,可安全发布。

RGB-Mini LED显示器与智能投影领衔,海信&Vidda六大3C潮品重磅发布

中国移动与火山引擎推出机密模型服务,为企业提供安全可信AI服务

双员值守,智护电网:国网浙江电力以“酷德+洛格”打造信息系统主动式运维体系

FFmpeg维护者JB Kempf:20人团队撑起全球互联网视频骨架,240000行汇编全靠手写,拒绝数千万美元

Antigravity A1无人机重大升级:AI剪辑与语音控制全面上线

北京车展 | 800V与SiC加速“上车”,隔离驱动芯片打响“本土高端突围战”

SkyfireAI获1100万美元融资,推动无人机自主协同作战

Ride1Up发布全球首款搭载半固态电池电动自行车

丰田与Hyroad携手推进南加州氢能重卡规模化部署

苹果探索与英特尔合作制造芯片,英特尔股价单日暴涨13%

9to5Mac每日播客:iOS 26.5 RC版本及苹果芯片合作伙伴最新动态

Threads网页版私信功能正式上线,但有几点需注意