ChatGPT横空出世,传统企业如何迎接“大模型”下的技术变革? 原创

ChatGPT的惊艳表现牵动了全球科技爱好者的心弦,仅仅2个月就实现了用户数从0到1亿的蜕变。ChatGPT能准确地理解语义并能进行流畅和较为正确的问答。多模态的大模型具备绘画、生成视频以及编写代码的能力。扩散模型的运用让人感到智能“涌现”的魅力,大模型的综合能力和效率甚至达到了专家级水平。

就在众多企业高管面对如此重大技术变革而感到不知所措和迷茫、焦虑时,那些对技术有着敏锐洞察力并勇于拥抱变革的企业已开始摩拳擦掌、跃跃欲试了。

没有万张加速卡,企业无缘大模型?

训练大模型需要巨大的算力,然而这些企业发现,在垂直行业,可借助各类开源模型,以及自己企业所积累的大量数据和经验,通过微调技术的再训练,就可以构建一个垂直领域的GPT(Generative Pre-Trained Transformer 生成式预训练Transfomer模型)模型。

企业真正要落地GPT却不是件容易的事,摆在眼前的就有三大挑战。在证券机构执掌技术团队多年、出任公司CTO的颜云峰表示:“我们首先遇到的就是算力难题。虽然微调技术并不像大模型那样需要成千上万张的AI加速卡,但所需的算力也是有极高的要求。这就需要企业能构造一个可扩展、能持续演进的算力发展架构。”

“第二是数据安全难题。无论是数据还是模型都是企业多年积累的高价值数据资产。因此无论在计算、存储中都要保障数据资产的安全。”

“第三是部署与运维难题。AI带来的新算力、存储需求要与原有IT系统融合、互通,加快数据流通的同时也增加了IT部署与运维的难度。”

持续创新应立即行动,但要做好五方面准备:

“希望通过持续创新提高竞争力的公司一定会选择立即行动。虽然这项技术还不成熟,但这也取决于公司自身的条件。任何AI的部署都是个非常复杂的工程。如果企业要实现规模化和可持续的生产,就需要在流程、技术和开发上做大量的准备工作。”HPE与AI云服务业务发展总监Edmondo Orlotti这样表示。

对此,对那些坚定地期望利用GPT创新的企业给出了五点建议,他表示:

“第一,要评估企业数据的成熟度水平。即战略、组织和技术能力,使其能够利用人工智能从数据中创造价值时,生成式人工智能才能生存和发展。但据HPE最新的全球调查显示,绝大多数组织在此能力上还存在巨大的差距。”

“第二,在数据架构和治理方面,企业需要搭建一个统一的公司级的数据架构和治理平台。完善数据架构和数据治理平台才能以优质的数据不断进行训练,以此推动企业的生产和服务不断地向好发展。”

“第三,做好采用混合平台的准备。 模型训练和推理可以在大型语言模型供应商(如OpenAI、Aleph Alpha、Google)运营的集中式AI超级计算机上运行,但从长远来看,会有各种原因会导致公司必须建立一个混合或边缘到云的平台。具有实时推理的用例要求模型在本地AI基础设施上运行,以尽量减少延迟。但随着训练数据越来越多地分布在各地,企业就要汇总数据,而不是将其集中起来,因为集中地数据成本极高且速度慢、不安全。”

“第四,知识产权和版权问题。生成式人工智可能是未来十年决定性技术之一,将对企业未来的发展起到战略性作用。可以预见,大型语言模型市场将被全球少数几个供应商所主导,这使得知识产权和版权将成为生成性人工智能的一个关键影响因素。企业应尽量减少对外的版权依赖和注重保护自身的知识产权。企业应采用混合方法规避相关风险,在本地运行具有版权的的大型语言模型。”

“第五,流程整合。企业在规划人工智能应用时,往往忽略了将其整合到现有的运营和技术流程中,这是造成人工智能项目失败的主要原因。企业应建立起包括应用和数据生命周期的管理、安全、运营规划和控制流程、运营安全和风险管理的各完善体系。”

HPE “四大能力”应对“三大挑战”,GPT解决方案让大模型飞入寻常“企业”家

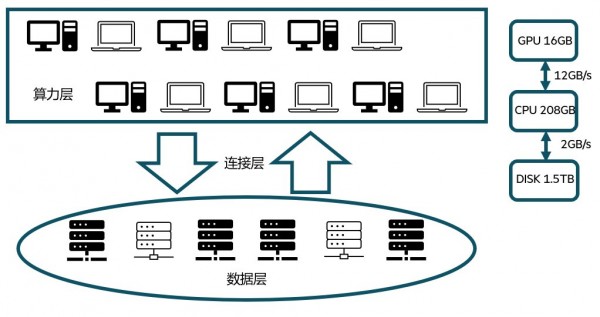

不论是大模型还是以LoRA这样的微调方式,都需要让模型适配不同算法和数据集,就需要底层硬件具备“由低向高”平滑过渡的整体解决方案。进而满足不同企业部署不同规模模型实现合理投入产出的方案。而这正是HPE GPT整体解决方案的优势所在,其核心就是算力和数据读写能力。

HPE通过GPT方案的四大能力来应对颜云峰所提出的三大挑战。

第一,灵活的动态调整能根据业务进行适配。

降低入门门槛,实现无缝衔接扩展,完美配合企业从入门到发展壮大的各阶段以及根据产品研发的进展动态调整是这一方案的特色之一。

计算资源上,企业可以从HPE ProLiant 系列服务器开始入门。HPE ProLiant服务器经过优化设计,可以为组织的数据密集型工作负载提供超高性能。与此同时,HPE ProLiant Gen11支持多种架构,包括第四代AMD EPYC™处理器,第四代Intel®Xeon® Scalable处理器,以及Ampere®Altra®和Ampere®Altra®Max云原生处理器。

进阶级的企业可以选择HPE Apollo 6500 服务器。它采用了业内领先的硬件配置与性能参数,HPE Apollo 6500 系统成为人工智能领域最高端的引擎。不仅是GPU与计算架构进行了升级,在计算、网络和存储各个方面都不会有性能瓶颈。

HPE Apollo 6500

最高8颗GPU计算架构,并支持NVLink2.0协议。NVLink能在GPU与GPU以及GPU与CPU间实现高带宽直连的快速通讯机制。单个NVIDIA Tesla V100 GPU 即可支持多达 6 条NVLink链路,总带宽为300Gb/秒,是PCIe 3.0带宽的10倍。NVLink2.0高效混合立方网格是目前最为高性能的解决方案。用户也可以使用基于PCIe的4:1或8:1的GPU:CPU连接。不同拓扑在高性能与易用性上各有优势,适用各种场景,用户可以根据业务模型灵活的选择。

HPE Apollo 6500 不仅能满足各类深度学习应用场景需求。其高度易用性和灵活性,充分降低了构建高性能人工智能系统的门槛,企业可以在HPE Apollo 6500 构建的坚实基础架构上以最短的时间完成对各类算法的训练。

第二,“6个9”的高可用性确保企业数据资产高效安全。

高达“6个9”的高可用性是HPE无论在计算还是存储上的标配。同时HPE存储支持远程复制对等持久性、保护模板、快照、克隆等多种数据保护措施。在All-NVMe的加持下能实现高性能、超低延迟的AI运算。

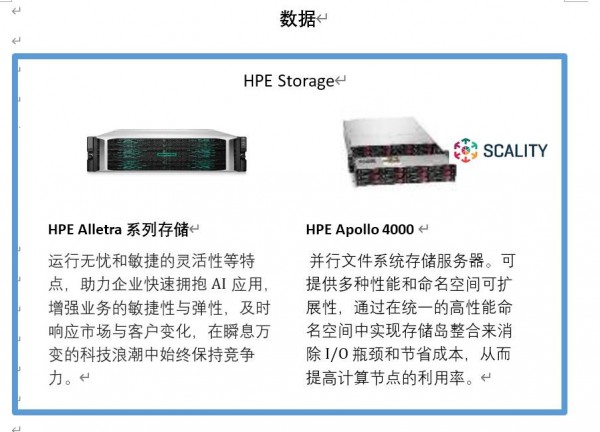

存储方面也为不同的企业提供了适合不同场景灵活、可持续发展的路线。GPT为代表的AI训练与预测需要更快、更大的存储。NVMe拥有更短的IO路径,更大的队列深度与宽度,以及更简单的协议堆栈等优势,同时,NVMe增加了多队列特性,对并行任务的友好设计也使得系统负载更加均衡,使闪存介质的性能得以充分发挥,NVMe SSD正全面替换SAS SSD和SATA SSD。

HPE Alletra是一款支持端到端NVMe的闪存系统,除了介质层NVMe SSD之外,还支持前端的NVMe-oF、以及数据处理层NVMe SCM,从而在整个数据链路上摆脱了传统存储阵列的瓶颈,性能势不可挡。同时,其独有的多活互联架构与NVMe+SCM的结合,配合软硬件上全面优化,可以跨越式地降低读写IO的时延,同样能更好地应对实时交易类,要求极致的IOPS需求。

HPE Apollo 4000

针对非结构化数据场景的训练与预测AI需求,对所有数据进行访问只是开始,能大规模管理数据、支持数据密集型应用并确保数据安全的系统则是关键。HPE Apollo 4000系统能够以极大规模存储数十亿个文件和对象。这一系统还可运行各种现代化、数据驱动型的应用。

第三,方案简单易用便于部署,加速企业的大模型上线。

为了让企业更加专注助于核心业务,降低企业在IT运维、部署的难度是HPE的职责所在。HPE ProLiant服务器采用基于云原生技术的管理中枢。无论计算环境位于何处,用户都能安全地自动访问、监控和管理服务器,进而实现高效运维。云原生管理中枢带来了便捷、统一和自动化的运维体验,通过实现全局可见性和洞察让您更好的管理计算环境。

HPE Alletra 系列存储同样采用云化的管理模式,以订阅方式1分钟就能实现数据上线。大幅降低了企业在IT方面的运维和部署难题。

第四,提供本地化服务,让企业无后顾之忧。

以Open AI为首的行业龙头在采用HPE的解决方案,同时,HPE利用本地化的合作伙伴网络,提供企业所需的策略帮助、运维支持和培训服务。能让企业获得从边缘到云的运维能力,从而加快企业的数智化转型。

ChatGPT是通用智能,“千人一面”。传统企业在体量上拥有灵活的优势,在数据上拥有深耕行业的专精数据与经验积累,利用好大模型技术则能让企业的服务实现“千人千面”更好地服务客户构建自身竞争力,也必将使其在细分行业大放异彩。

好文章,需要你的鼓励

大众汽车推进平价电动车战略,两款新车率先下线

大众汽车旗下ID. Polo与Cupra Raval已在西班牙马托雷尔工厂正式下线投产。两款车型起售价分别为24,995欧元和26,000欧元,均基于MEB+平台打造,搭载37kWh或52kWh电池组,续航里程最高可达454公里。这是大众"电动城市车家族"系列的首批产品,预计今年夏末秋初开始交付。大众集团通过跨品牌资源整合,实现约6亿欧元的成本节约,后续还将推出ID. Cross等新成员。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

三星宣布将于6月8日起为Samsung Health应用推出重磅功能更新,赶在Galaxy Watch 9传闻发布之前落地。新版本将引入多项AI驱动的生物特征分析功能,包括:综合心率、血氧、皮肤温度等数据的每日活力评分(Vitals)、结合体成分数据评估长期心脏健康的心脏健康评分、优化训练强度的每日有氧负荷追踪,以及横向对比用户群体的健身指数。此外,应用界面将重新划分为睡眠、营养、活动、正念和体征五大板块,并新增抗氧化指数、年龄指数和听力保护等个性化功能。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

Meta智能眼镜被曝含"人脸识别"追踪代码,隐私风险引发警示

Gemini企业智能体平台的智能体RAG如何实现可靠响应

麻省理工学院AI与计算研讨会:技术进步中不可或缺的人文因素

亚马逊全新数据中心路由架构降低AWS网络能耗40%

iOS 27即将发布,多款iPhone应用将迎来全新设计升级

连接性已成为与计算和存储同等重要的AI基础设施核心要素

开发者仍在等待Meta最新AI模型的API访问权限

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

米拉·穆拉提重返公众视野,谨慎发声

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议