VMware CTO Kit Colbert:多领域创新 VMware与合作伙伴推动可持续发展

如今,绿色低碳的可持续发展已经成为全球共识,但是整个ICT行业是能源消耗大户,特别是数据中心和5G网络的能源消耗在持续增加,。

目前,信息与通信技术(ICT)行业用电量占全球总用电量7%以上,到2030年,该占比预计将达到13%。到2025年,RAN(无线接入网)将消耗电信公司大约55%的电力。

随着能源消耗情况日益严峻,我们必须采取行动来解决整个问题,ICT行业开始真正关注虚拟化和硬件效率,以求实现更少的碳排放和能源使用。

VMware高级副总裁兼首席执行官Kit Colbert告诉记者,VMware拥有全线的产品,通过整合提高利用率、自动化注入更多的智能,比如借助机器学习技术达成节能减排的目标。

VMware使用数据构建模型,识别机器上闲置的“僵尸进程”。这些进程无益于计算,但却在消耗不必要的能源,增加了数据中心的碳足迹。我们可以通过AI自动决策,将这些进程整合到少量机器上,节约能源消耗。VMware的虚拟化技术在这个过程中发挥了关键作用。

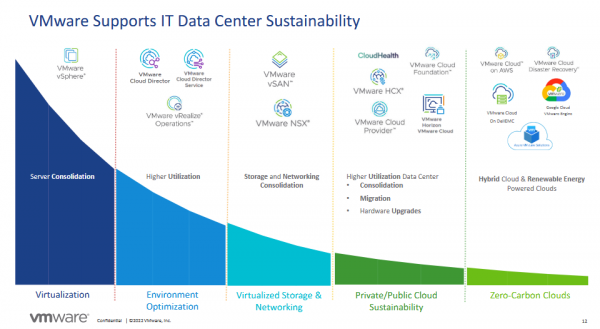

面对能源挑战,VMware进行了持续技术创新,比如在私有云领域,通过虚拟化技术削减能源的消耗量,实现节能减排。在过去二十多年中,VMware帮助客户削减了大概12亿吨的碳排放,它约等于25亿兆瓦的能源消耗量。

一个公司采用虚拟化技术的数量与其数据中心运营的可持续性之间有直接关系。VMware通过整合服务器,在其他行业的能源消耗持续增加的情况下,使世界数据中心的电力消耗量维持不变。

其实在计算行业,VMware产业链各个环节进行合作,既包括硬件厂商,也包括软件厂商。例如VMware和数据中心、运营商,以及本土合作伙伴,甚至芯片级的厂商,都进行了合作。

VMware、英特尔和Quarkdata(云创远景)合作开发了联合解决方案 DeepCooling,以加速推动在中国乃至全球数据中心规模化采用可持续的碳中和计算技术。DeepCooling可持续的碳中和计算技术通过持续的边缘AI干预和实时控制,帮助企业优化数据中心的整套制冷体系的能耗表现。

Kit Colbert表示,ARM芯片架构能够实现比X86更高的能源效率,于是VMware支持ARM芯片,从而实现更高的算力效率。

在公有云方面,我们可以提升能源利用率,应对高密度的工作负载,实现节能减排。在爱尔兰,一家大型工业设备供应商ESB,使用基于AWS公有云上的VMware技术来实现大幅的节能减排,并最大化他们可再生能源的占比。

在电信运营商方面,5G将会极大消耗能源。VMware在开放RAN领域进行创新,例如提高光谱的利用率,因为频谱在消耗能源中比较很大,VMware携手合作伙伴实现创新,能够把性能提升一倍,而能耗降低一半。

在边缘侧,奥迪不断进行自身IT及基础设施的优化,通过使用VMware的技术,他们仅在2021年一年的时间就节约了7万兆瓦的能源,

同时,VMware携手合作伙伴共同启动零碳承诺计划(VMware Zero Carbon Committed),将VMware客户与云服务提供商联系起来,帮助他们实现可持续发展和供应链脱碳目标。目标是在2030年,VMware实现零碳云。

参加该计划的云服务提供商,将与VMware一样,承诺用100%可再生能源为其数据中心供电,或在2030年之前实现碳中和。同时,上述服务提供商通过了VMware的云计算认证,将使用完整的VMware云基础架构为其客户提供云计算服务。

众所周知,VMware面向合作伙伴推出了VMware Partner Connect计划,此前这一计划并没有在节能减碳方面给予相关建议和指导,现在启动零碳承诺计划之后,VMware会和作伙伴分享最佳实践和建议,帮助他们实现数据中心的优化,以及鼓励他们更多使用可再生能源,从而推动零碳云计划的实施。目前已经有众多的VMware的合作伙伴签约加入此计划。

Kit Colbert说,成本问题是阻碍客户迈向可持续发展的重要挑战,而零碳承诺计划可以极大帮客户降低整个技术平台迁移的成本,同时又实现了零碳的目标。

展望未来,Kit Colbert表示,ICT行业节能减排需要从横向和纵向两个维度进行切入,横向是指跨行业的通用技术以实现节能减排,纵向是指针对不同的行业提供独一无二的技术方案。

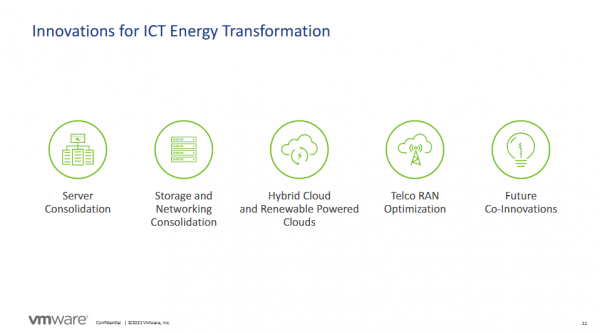

VMware聚焦以下领域致力于创新,实现能源的消耗降低。第一个领域是服务器和存储设备等基础设施方面,通过整合来实现节能的目标。第二大领域是在混合云以及由可再生能源驱动的云中实现节能。第三个领域是电信运营商RAN,通过优化实现节能目标。“我们持续地进行具有前瞻性的创新,联手合作伙伴共同为节能进行努力。”Kit Colbert最后说。

来源:至顶网计算频道

好文章,需要你的鼓励

Glean年收入突破3亿美元,削减AI成本成核心卖点

企业AI搜索公司Glean宣布年度经常性收入(ARR)达3亿美元,较15个月前的1亿美元增长三倍。尽管谷歌、微软、OpenAI等科技巨头纷纷入局企业AI搜索市场,Glean凭借"上下文图谱"技术深度理解企业业务需求,并帮助客户显著降低AI计算成本。该公司提供按用量计费和混合定价两种模式,客户涵盖Databricks、Reddit、Pinterest及三星等企业。Glean上轮融资后估值达72亿美元。

香港中文大学与MiniMax联手破解AI图像描述的“说多错多、说少漏多“困局

香港中文大学与MiniMax提出ClaimDiff-RL框架,将图像描述的AI训练从整体打分升级为逐条核查,有效解决了传统方式导致AI"少说保平安"的问题,同时在多项基准测试上超越Gemini-3-Pro-Preview。

蓝色起源“新格伦“火箭在佛罗里达测试中发生爆炸

杰夫·贝索斯旗下的蓝色起源公司在佛罗里达卡纳维拉尔角进行静态点火测试时,新格伦重型火箭发生爆炸。这是美国历史上最大规模的火箭爆炸之一,也是蓝色起源公司遭遇的最严重失败。所有人员安全,但该事故可能导致新格伦火箭项目长期暂停。此前该火箭已成功完成三次发射,并实现了助推器回收和重复使用。

NTU、HKU等多所顶校联手,让AI同时“多角度看片“——视频理解的并行探针革命

ParaVT是一个由南洋理工等多校联合提出的并行视频工具调用框架,通过让AI同时分析多段视频并引入PARA-GRPO算法解决训练中的格式崩溃与工具跳过问题,在六项长视频理解测试中平均提升约7.9%。

Glean年收入突破3亿美元,削减AI成本成核心卖点

蓝色起源"新格伦"火箭在佛罗里达测试中发生爆炸

智能体AI正在重塑企业架构与Token经济学

堪培拉理工学院如何借助技术革新重塑课堂教学体验

Gemma 4携手Arm:优化端侧AI,加速移动应用体验

制药公司与初创企业如何携手推动AI落地

《星球大战》导演盛赞生成式AI:电影制作的革命性工具

Salesforce借助Informatica布局企业级无头数据管理架构

几乎所有M5 MacBook Air配置现在都降价近200美元

企业用好Agent,关键不在“买一个智能体”|原点Talk 分享会

大模型评测风向变了,Testin云测如何构建企业级AI质量标尺?

因民事养老金管理失误,英国政府拒绝向Capita授予5.63亿英镑合同