持续分享云原生技术实践,华为再度亮相CNCF顶级盛会

5月16-20日,CNCF年度旗舰峰会KubeCon+CloudNativeCon Europe 2022在西班牙瓦伦西亚及线上同步举行。会上,华为与来自全球的云原生开发者共论持续通过云原生技术创新加速全球数字化转型,通过主题演讲、展览等为全球的云原生开发者分享华为开源项目的最新进展及在各行各业的成功应用。

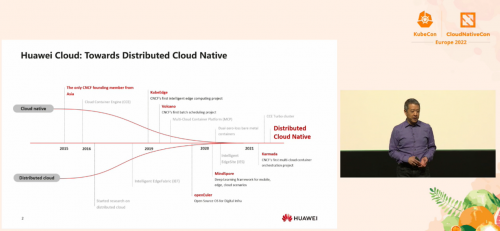

华为首席战略官、CNCF理事会成员Bryan Che在以创新持续探索云原生边界为题的主题演讲中表示:“在华为,我们一直在努力延伸云原生的边界,将云原生推向更广阔的领域,推向比以往任何时候都更广泛的规模,以及运行AI和机器学习等更高级别的工作负载。而且,我们一直在与其他公司合作,以扩大云原生社区。”

主题演讲:Exploring the Frontier of Cloud Native

大会上,华为专家也分享了KubeEdge、MindSpore在卫星增量学习场景中的应用。近地轨道卫星(LEO)是近年的热门话题之一,华为云研发的智能边缘计算平台KubeEdge成功地将云原生带入了太空。通过几颗配备KubeEdge的小型研究卫星,在宇宙深处试验了人工智能的边缘计算。将云原生边缘机器学习套件 KubeEdge Sedna 与 TinyMS(一个用于MindSpore深度学习框架的高级API工具包)结合起来,使卫星能够进行增量学习,以完成遥感和地球观测等任务。

KubeCon+CloudNativeCon Europe 2022华为展区

事实上,华为对于云原生开源社区的重视与支持由来已久。2015年,华为作为创始会员之一,与Google、RedHat、IBM等企业共同发起并创立CNCF,华为在CNCF社区的代码贡献量亚洲第一。华为持续将积累的云原生能力开放给业界,陆续向CNCF捐献多个开源项目,包括批量计算项目Volcano、智能边缘项目KubeEdge、多云容器编排项目 Karmada。其中, KubeEdge于2020年9月16日正式晋级为CNCF孵化项目;Volcano于2022年4月7日正式晋级为CNCF孵化项目。

KubeEdge目前对于固定边缘场景已经支持良好,正在增强对可移动边缘的支持。并进一步应用在卫星、汽车、能源等场景。机器人、云原生车等成为新的应用研究方向。新增DMI、节点分组、动态中继、EdgeMesh等新特性。Volcano目前在互联网、金融、能源、生命科学、交通等行业都已经有成功应用,其关键特性包括Spark on Kubernetes默认调度引擎、支持CPU Numa感知、支持GPU虚拟化、支持GPU Numa感知、支持Gang Scheduling等高级调度算法集、支持基于应用感知的调度、支持作业弹性伸缩管理等。Karmada致力于满足多集群管理、多集群CICD、应用跨域部署/地域亲和、多集群服务治理、集群容灾/故障迁移、多集群应用弹性伸缩等场景的应用,目前已可以支持30万节点100集群规模。

经过全球众多组织、企业和开发者的共同努力,云原生技术得到快速的发展。Gartner预测:2025年基于云原生平台的数字化业务比例将达到95%。华为云正是洞察到这个必然的发展趋势,早在2020年底,华为云即率先提出“云原生2.0”。云原生已经成为企业实现高质高效数字化转型的必然选择。任何企业都能通过云原生化成为新云原生企业。华为在云原生领域持续投入与创新也得到来自各行各业客户的信赖,华为云连续三次蝉联中国容器市场份额第一。让我们一起加入到云原生技术蓬勃创新和应用的浪潮中,共同加速迈入智能世界。

来源:业界供稿

好文章,需要你的鼓励

苹果48GB M5 Pro MacBook Pro创历史新低,直降300美元

B&H近期对多款M5 Pro MacBook Pro机型推出300美元优惠。14英寸M5 Pro版本(48GB内存+1TB固态硬盘)现售价2299美元,较原价2599美元节省300美元,且该配置在亚马逊无法购买,折扣机会更为难得。此外,16英寸M5 Pro版本(64GB内存+1TB固态硬盘)同样享有300美元折扣。B&H在多款高配MacBook机型上的定价已低于亚马逊,是近期可找到的最优价格。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

Insta360推出GO 3S复古套装,将现代4K运动相机与胶片时代美学结合。套装核心仍是仅重39克的GO 3S,新增复古取景器、胶片风格滤镜、NFC定制外壳及可延长录制时长至76分钟的电池组。复古取景器模仿老式腰平相机设计,鼓励用户放慢节奏、专注构图。相机内置11种色彩预设及负片、正片等滤镜,同时保留FlowState防抖、4K拍摄及10米防水能力,面向热衷复古影像风格的年轻创作者。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

CarPlay 新增两款音频应用,让你的旅途更精彩

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

谷歌免费存储空间调整:未绑定手机号仅享5GB

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

智简融媒 创新视听|华为助力传媒行业发展新质生产力

华为 Mate X6 折叠屏手机外观公布开启预定,26 日同期发布

万余款数智产品、上千场全国行动 华为联手上万家伙伴启动第三届828 B2B企业节

华为如何抓住全闪化百亿市场新机遇?

闪存普惠,一步到位 华为正式发布极简全闪数据中心暨伙伴先锋行动

华为发布园区网络“光进铜退”先锋行动 ——将投入5000万元营销资源支持新老伙伴共赢园区数智新未来

华为老将余承东,字典里没有躺平

新商机|新标配|新支持,园区网络光进铜退先锋行动发布会

华为发布星河AI网络解决方案,携手全球伙伴共同倡议加快Net5.5G产业演进发展

华为陈帮华:打造F5G-A高品质运力网,形成“全国一台计算机”