NVIDIAґтЖЖAIНЖАнРФДЬјЗВј

NVIDIAЖѕЅиA100ЅшТ»ІЅА©ґуБЛФЪMLPerf»щЧјІвКФЦРµДБмПИУЕКЖЈ¬КµПЦБЛ±ИCPUїм237±¶µДAIНЖАнРФДЬЈ¬ЦъБ¦ЖуТµЅ«AIСРѕїЧЄ»ЇОЄЙъІъБ¦

јУАыёЈДбСЗЦЭКҐїЛААКР—2020Дк10ФВ22ИХ—NVIDIAЅсИХРыІјЈ¬ЖдAIјЖЛгЖЅМЁФЪЧоРВТ»ВЦMLPerf»щЧјІвКФЦРФЩґОґтЖЖРФДЬјЗВјЈ¬ФЪХвТ»ТµДЪОЁТ»ЖА№АУІјюЎўИнјюєН·юОсµДµЪИэ·ЅAIРФДЬ»щЧјІвКФЦРЅшТ»ІЅА©ґуБЛЖдБмПИУЕКЖЎЈ

ФЪЅсДкµЪ¶юВЦMLPerf НЖАнІвКФЦРЈ¬NVIDIAґґПВБЛКэѕЭЦРРДУл±ЯФµјЖЛгПµНіИ«ІїБщёцУ¦УГБмУтµДјЗВјЎЈґЛґОІвКФЦРЈ¬јЖЛг»ъКУѕхІвКФґУЧоіхµДБЅПоА©Х№µЅЛДПоЈ¬єёЗБЛAIУ¦УГФці¤ЧоїмµДБмУтЈ¬°ьАЁЈєНЖјцПµНіЎўЧФИ»УпСФАнЅвЎўУпТфК¶±рєНТЅБЖУ°ПсЎЈ

ЖѕЅиNVIDIA A100 Tensor Core GPUіцЙ«µДНЖАнРФДЬЈ¬ёчёцРРТµµД»ъ№№Ѕ«AIСРѕїЧЄ»ЇОЄИХіЈФЛУЄЦРµДЙъІъБ¦ЎЈЅрИЪ»ъ№№К№УГ¶Ф»°КЅAIёьїмЛЩµШ»ШґрїН»§ОКМвЈ¬БгКЫЙМГЗК№УГAI±ЈЦ¤»хјЬївґжідЧгЈ¬ТЅБЖ»ъ№№К№УГAI·ЦОцКэ°ЩНтХЕТЅБЖУ°ПсЈ¬ТФёьЧјИ·µШХп¶ПјІІЎЈ¬ґУ¶шНмѕИЙъГьЎЈ

NVIDIAјУЛЩјЖЛгІїГЕЧЬѕАнјжё±ЧЬІГIan Buck±нКѕЈє“ОТГЗХэґ¦ФЪТ»ёцЧЄХЫµгЈ¬ёчёцРРТµ¶јЦВБ¦УЪёьєГµШАыУГAIЈ¬ґУ¶шМṩРВµД·юОсІўС°ЗуТµОсµД·ўХ№ЎЈ”

“NVIDIAОЄMLPerfЙПИЎµГµДіЙјЁё¶іцБЛѕЮґуµДЕ¬Б¦Ј¬Ѕ«ЦъБ¦ёчЖуТµµДAIРФДЬМбЙэµЅРВµДёЯ¶ИЈ¬ТФёДЙЖОТГЗµДИХіЈЙъ»оЎЈ”

ФЪMLPerfЧоРВЅб№ыіцВЇЦ®јКЈ¬NVIDIAµДAIНЖАнТµОсТІТѵõЅСёЛЩА©Х№ЎЈОеДкЗ°Ј¬Ц»УРЙЩКэБмПИµДёЯїЖјј№«ЛѕК№УГGPUЅшРРНЖАнЎЈПЦФЪЈ¬ЖуТµїЙНЁ№эёчґуФЖєНКэѕЭЦРРД»щґЎЙиК©№©У¦ЙМАґК№УГNVIDIAµДAIЖЅМЁЎЈёчРРТµ¶јФЪК№УГNVIDIAµДAIНЖАнЖЅМЁёДЙЖТµОсФЛУЄЈ¬Мṩёь¶аµД·юОсЎЈ

ґЛНвЈ¬NVIDIA GPUКЧґОФЪ№«УРФЖЦРКµПЦБЛі¬ФЅCPUµДAIНЖАнДЬБ¦ЎЈ»щУЪ NVIDIA GPUµДЧЬМеФЖ¶ЛAIНЖАнјЖЛгДЬБ¦ГїБЅДкФці¤Фј10±¶ЎЈ

NVIDIAОК¶¦AIНЖАнРФДЬµДРВёЯ·е

NVIDIAј°ЖдєПЧч»п°йМбЅ»БЛ»щУЪNVIDIAјУЛЩЖЅМЁµДMLPerf 0.7µДІвКФЅб№ыЎЈёГЖЅМЁ°ьє¬NVIDIAКэѕЭЦРРДGPUЎў±ЯФµAIјУЛЩЖчєНѕ№эУЕ»ЇµДNVIDIAИнјюЎЈ

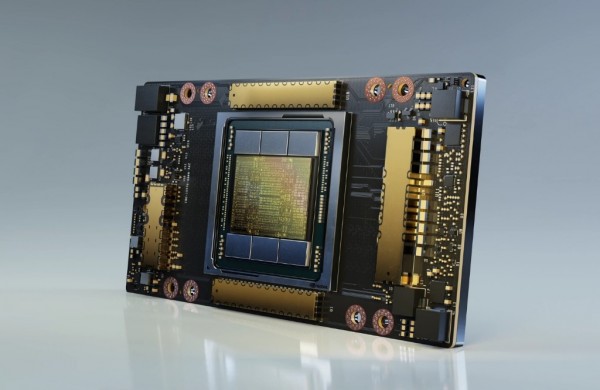

NVIDIA УЪЅсДкФзР©К±єт·ўІјБЛA100ЎЈЖѕЅиЖдµЪИэґъTensor CoreєЛРДєН¶аКµАэGPUјјКхЈ¬A100ФЪResNet-50ІвКФЦРµДБмПИУЕКЖЅшТ»ІЅА©ґуЎЈФЪЙПТ»ВЦІвКФЦРЈ¬ЛьТФ30±¶±И6±¶µДіЙјЁ»ч°ЬБЛCPUµДІвКФЅб№ыЎЈБнНвЈ¬ґЛґОMLPerf Inference 0.7»щЧјІвКФЦРЈ¬РВФцБЛХл¶ФКэѕЭЦРРДНЖАнРФДЬµДНЖјцПµНіІвКФЎЈФЪёГІвКФЦРЈ¬A100ЛщХ№ПЦіцµДРФДЬ±ИЧоПИЅшµДCPUёЯіц237±¶ЎЈ

ХвТвО¶ЧЕЈ¬Т»МЧDGX A100ПµНіїЙТФМṩПаµ±УЪЅь1000МЁЛ«ІеІЫCPU·юОсЖчµДРФДЬЈ¬ДЬОЄїН»§AIНЖјцПµНіДЈРНґУСР·ўЧЯПтЙъІъµД№эіМЈ¬Мṩј«ёЯµДіЙ±ѕР§ТжЎЈ

»щЧјІвКФЅб№ыПФКѕЈ¬NVIDIA T4 Tensor Core GPUИФИ»КЗЦчБчЖуТµЎў±ЯФµ·юОсЖчєНёЯіЙ±ѕР§ТжФЖКµАэµДїЙїїНЖАнЖЅМЁЎЈФЪН¬Т»ІвКФЦРЈ¬NVIDIA T4 GPUµДРФДЬ±ИCPUёЯіц28±¶ЎЈґЛНвЈ¬NVIDIA Jetson AGX XavierТСіЙОЄ»щУЪSocµД±ЯФµЙи±ёЦРЧоЗїґуµДЖЅМЁЎЈ

ХвР©Ѕб№ыАлІ»їЄёЯ¶ИУЕ»ЇµДИнјю¶СХ»Ј¬°ьАЁNVIDIA TensorRTНЖАнУЕ»ЇЖчєНNVIDIA TritonНЖАн·юОсИнјюЎЈХвБЅїоИнјю¶СХ»ѕщїЙФЪNGCЈЁNVIDIAµДИнјюДїВјЈ©ЦР»сИЎЎЈ

іэNVIDIAМбЅ»µДЅб№ыНвЈ¬»№УР11јТNVIDIAєПЧч»п°йМбЅ»БЛ»щУЪNVIDIA GPUµД1029ёцІвКФЅб№ыЈ¬ХјКэѕЭЦРРДєН±ЯФµАа±рЦРІОЖАІвКФЅб№ыЧЬКэµД85ЈҐТФЙПЎЈ

єГОДХВЈ¬РиТЄДгµД№ДАш

ґуЦЪЖыіµНЖЅшЖЅјЫµз¶ЇіµХЅВФЈ¬БЅїоРВіµВКПИПВПЯ

ґуЦЪЖыіµЖмПВID. PoloУлCupra RavalТСФЪОч°аСАВнНРАЧ¶ы№¤і§ХэКЅПВПЯН¶ІъЎЈБЅїоіµРНЖрКЫјЫ·Ц±рОЄ24,995Е·ФЄєН26,000Е·ФЄЈ¬ѕщ»щУЪMEB+ЖЅМЁґтФмЈ¬ґоФШ37kWh»т52kWhµзіШЧйЈ¬РшєЅАпіМЧоёЯїЙґп454№«АпЎЈХвКЗґуЦЪ"µз¶ЇіЗКРіµјТЧе"ПµБРµДКЧЕъІъЖ·Ј¬Ф¤јЖЅсДкПДД©ЗпіхїЄКјЅ»ё¶ЎЈґуЦЪјЇНЕНЁ№эїзЖ·ЕЖЧКФґХыєПЈ¬КµПЦФј6ТЪЕ·ФЄµДіЙ±ѕЅЪФјЈ¬єуРш»№Ѕ«НЖіцID. CrossµИРВіЙФ±ЎЈ

µ±AI»ъЖчИЛЎ°ЧФРЕµШЎ°ЧІПтЗЅ±ЪЈєSTATE16СРѕїФєЅТКѕОпАнAIПµНіЦРДЗР©ОЮЙщОЮПўµДЦВГьґнОу

STATE16СРѕїФєХвЖЄЧЫКц·ўПЦЈ¬ОпАнAIПµНіґжФЪ"ѕІД¬К§Р§"·зПХЎЄЎЄAIТФёЯ¶ИЧФРЕЦґРР»щУЪґнОуКАЅзРЕПўµД¶ЇЧчЈ¬ИґІ»ґҐ·ўИОєО±ЁѕЇЈ¬ІўМбіцФЪAIКдіцУлОпАнЦґРРЦ®јдЅЁБў¶АБўКЪИЁІгµДїтјЬЎЈ

ИэРЗHealthУ¦УГУАґAIЙэј¶Ј¬Galaxy Watch 9·ўІјЗ°П¦ёьРВМбЗ°ЅТПю

ИэРЗРыІјЅ«УЪ6ФВ8ИХЖрОЄSamsung HealthУ¦УГНЖіцЦШ°х№¦ДЬёьРВЈ¬ёПФЪGalaxy Watch 9ґ«ОЕ·ўІјЦ®З°ВдµШЎЈРВ°ж±ѕЅ«ТэИл¶аПоAIЗэ¶ЇµДЙъОпМШХч·ЦОц№¦ДЬЈ¬°ьАЁЈєЧЫєПРДВКЎўСЄСхЎўЖ¤·фОВ¶ИµИКэѕЭµДГїИХ»оБ¦ЖА·ЦЈЁVitalsЈ©ЎўЅбєПМеіЙ·ЦКэѕЭЖА№Аі¤ЖЪРДФаЅЎїµµДРДФаЅЎїµЖА·ЦЎўУЕ»ЇСµБ·Зї¶ИµДГїИХУРСхёєєЙЧ·ЧЩЈ¬ТФј°єбПт¶Ф±ИУГ»§ИєМеµДЅЎЙнЦёКэЎЈґЛНвЈ¬У¦УГЅзГжЅ«ЦШРВ»®·ЦОЄЛЇГЯЎўУЄСшЎў»о¶ЇЎўХэДоєНМеХчОеґу°еїйЈ¬ІўРВФцї№Сх»ЇЦёКэЎўДкБдЦёКэєНМэБ¦±Ј»¤µИёцРФ»Ї№¦ДЬЎЈ

µ±AIС§»бЎ°±ЯёЙ±ЯС§Ў°ЈєUIUCУлОўИнБЄєПґтФмµДНшТіЦЗДЬМеСµБ·РВ·¶КЅ

UIUCУлОўИнБЄєПСР·ўµДOpenWebRLїтјЬИГ4BРЎДЈРНЅцЖѕ400МхіхКјКэѕЭЈ¬НЁ№эФЪХжКµНшХѕЙП±ЯЧц±ЯС§µДЗї»ЇС§П°·ЅКЅЈ¬ФЪНшТіЦЗДЬМе»щЧјЙПі¬ФЅБЛУГ27НтМхКэѕЭСµБ·µДѕєХщ¶ФКЦЎЈ

ИэРЗHealthУ¦УГУАґAIЙэј¶Ј¬Galaxy Watch 9·ўІјЗ°П¦ёьРВМбЗ°ЅТПю

MetaЦЗДЬСЫѕµ±»ЖШє¬"ИЛБіК¶±р"Ч·ЧЩґъВлЈ¬ТюЛЅ·зПХТэ·ўѕЇКѕ

GeminiЖуТµЦЗДЬМеЖЅМЁµДЦЗДЬМеRAGИзєОКµПЦїЙїїПмУ¦

ВйКЎАн№¤С§ФєAIУлјЖЛгСРМЦ»бЈєјјКхЅшІЅЦРІ»їЙ»тИ±µДИЛОДТтЛШ

СЗВнС·И«РВКэѕЭЦРРДВ·УЙјЬ№№ЅµµНAWSНшВзДЬєД40%

iOS 27јґЅ«·ўІјЈ¬¶аїоiPhoneУ¦УГЅ«УАґИ«РВЙијЖЙэј¶

Б¬ЅУРФТСіЙОЄУлјЖЛгєНґжґўН¬µИЦШТЄµДAI»щґЎЙиК©єЛРДТЄЛШ

їЄ·ўХЯИФФЪµИґэMetaЧоРВAIДЈРНµДAPI·ГОКИЁПЮ

ВхПтTokenѕјГК±ґъЈ¬F5ТФЎ°AIёіДЬЅ»ё¶Ў±Цю»щЦЗДЬРВЙъМ¬

ГЧАЎ¤ДВАМбЦШ·µ№«ЦЪКУТ°Ј¬ЅчЙч·ўЙщ

МШЛ№АТЙЛЖЙѕіэFSDЦ¤ѕЭЈ¬їЁМШ±ЛАХјУЛЩµз¶Ї»ЇІјѕЦЈ¬ёЯС№ПµНіјјКхЕаСµїМІ»ИЭ»є

ЦЗДЬМеНшВзБчБїКЧі¬ХжИЛ·ГОКЈ¬"ЛАНц»ҐБЄНш"АнВЫТэ·ўРВХщТй

РФДЬїсм70%ЈЎ±¦µВ x ѕ©¶«ФЖAIґжґўТ»Ме»ъРВЖ·ЙПКРЈ¬ЦШЛЬРРТµ±кёЛ

ЛјїЖУлУўО°ґпА©ґуєПЧчЈ¬ЦъБ¦ЖуТµјУЛЩУ¦УГAIјјКх

БЅО»З°№ИёиИнјю№¤іМК¦Ј¬УГAIёДРґєЪТ№іЙПс№жФт

µВЗЪ2025јјКхЗчКЖ±ЁёжЈ¬AIУлЖуТµОґАґµДЅ»»г

ЛјїЖФЪCisco Live°ўД·Л№МШµ¤ґу»бЙПХ№КѕјтЅаЎў°ІИ«єНAIѕНРчµДґґРВјјКх

Зш·ЦЎ°ДЈРНЎ±єНЎ°У¦УГЎ±КЗ¶ФAIЧоґуµДОуЅв

ЦХ¶ЛІаAIЈ¬ИзєОґУDeepSeekµДБ¬Лш·ґУ¦ЦРКЬТжЈї

Gartner·ўІј2025Дкј°ОґАґЦР№ъЖуТµКµПЦAIјЫЦµµДЦШТЄФ¤Ів

NVIDIA Blackwell ПЦТСФЪФЖ¶ЛИ«ГжїЙУГ

ЧЁ·ГDeepMind CEOЈєОТГЗѕаАлКµПЦAGIЦ»Ри5-10Дк