华为在CEBIT上发布高端KunLun V5服务器

华为在CEBIT上推出了一款功能更强大的高端KunLun服务器,此外还公布了其他硬件和软件的公告。

KunLun是华为的一款大型服务器,在一个机架中可容纳多达32个CPU。这个V5版本基本上是升级采用了至强SP,支持NVMe驱动器,这也华为对其服务器产品线进行Skylake升级的最新举措。

这款新服务器专门用于X86服务器高端市场,即所谓的关键任务场景,这个可扩展的机箱由4个SCE子机箱构成,每个子机箱配置2到8个处理器,12TB的DDR4内存(96个DIMM)和1个CME中央管理机箱。这个服务器产品线有3种型号,9008配置8个处理器,9016配置2个处理器,9032有4个。9008和9016可升级到32个CPU。

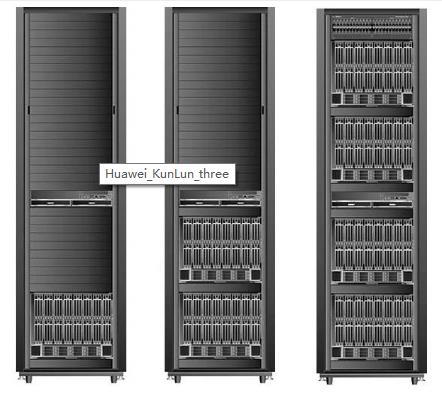

KunLun 9008(左)、9016(中)和9032(右)

处理器要么是Xeon Platinum 8100或Gold 6100处理器,每个节点最多768个内核(24核CPU)和32TB内存。

这款系统在物理上可分区为4-CPU组,或者每个主机最多可以有40个1-96 CPU核心逻辑分区。此外有PCIe扩展插槽、2个10GbitE SFP+端口和2个GE RJ45端口。

每个SCE的本地存储容最高可达到48个2.5英寸SAS/SATA磁盘驱动器,或者40个2.5英寸NVMe SSD。数据规格表中并没有透露容量。RAID级别支持0、1、10、5、50、6和60,操作系统方面支持RedHat、SuSE Linux、、Windows Server和VMware ESX。

华为表示,KunLun v5具有一个多层容错架构,带有容错芯片、固件和操作系统,它是完全冗余的,没有单点故障。我们得知KunLun v5它RISC服务器性能高出40%,但没有给出细节。

为什么是32个CPU的机架服务器而不是32个单独的机架服务器?简短回答的话,就是你可以将CPU和核心分组到多个计算单元,并根据工作负载进行调整计算单元的大小。

如果你有一组可变大小的工作负载(需要在不同时间和不同组合中运行),那么可以将一台8个、16个或32个CPU的进行灵活且动态的修改成为适当大小的计算单元,通过物理分区和逻辑分区。

这不会使它成类似HPE Synergy/Attala/DriveScale/Liqid那样的可组合式服务器(可以从资源池动态定义计算、内存和存储分组)。KunLun与其他厂商的32路服务器有何不同?

其他一些大型服务器厂商

思科在这方面并没有一款服务器产品。

戴尔m100e 10U刀片式服务器机箱可容纳16个刀片,每个刀片都可以是一个4路系统,采用22核至强E5-4600 v4 CPU,总共64个CPU和1408个核心。

但这是升级到Skylake之前的系统,没有类似KunLun那样的集中管理的4机箱系统。富士通的刀片式服务器机箱产品似乎也是如此。

日立在2016年推出了12U的CB 2500机箱,配备14个双处理器刀片服务器模块。有一个支持LPAR的8插槽CB520X刀片模块。这款刀片机箱系统没有升级到Skylake。

HPE的Integrity机架服务器采用安腾处理器,Superdome Flex在8个5U机箱组合在一起的时候支持32个至强SP处理器和48TB内存。

当然,IBM有自己的大型机系统,基于Power9的AC922(Power9,22核)配备有2到6个Tesla V100 CPU,可扩展为1个全机架或多个机架。

华为还在其CeBit上推出了其他新产品,如Internet of Vehicles套件、支持40多款云服务的FusionCloud 6.3全堆栈产品、以及FusionInsight LibrA融合数据仓库等。

华为表示,这款产品采用并行计算、混合行列存储和矢量化执行技术,可在数秒内完成数万亿条数据记录的关联分析。

好文章,需要你的鼓励

苹果48GB M5 Pro MacBook Pro创历史新低,直降300美元

B&H近期对多款M5 Pro MacBook Pro机型推出300美元优惠。14英寸M5 Pro版本(48GB内存+1TB固态硬盘)现售价2299美元,较原价2599美元节省300美元,且该配置在亚马逊无法购买,折扣机会更为难得。此外,16英寸M5 Pro版本(64GB内存+1TB固态硬盘)同样享有300美元折扣。B&H在多款高配MacBook机型上的定价已低于亚马逊,是近期可找到的最优价格。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

Insta360推出GO 3S复古套装,将现代4K运动相机与胶片时代美学结合。套装核心仍是仅重39克的GO 3S,新增复古取景器、胶片风格滤镜、NFC定制外壳及可延长录制时长至76分钟的电池组。复古取景器模仿老式腰平相机设计,鼓励用户放慢节奏、专注构图。相机内置11种色彩预设及负片、正片等滤镜,同时保留FlowState防抖、4K拍摄及10米防水能力,面向热衷复古影像风格的年轻创作者。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

CarPlay 新增两款音频应用,让你的旅途更精彩

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

谷歌免费存储空间调整:未绑定手机号仅享5GB

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

智简融媒 创新视听|华为助力传媒行业发展新质生产力

华为 Mate X6 折叠屏手机外观公布开启预定,26 日同期发布

万余款数智产品、上千场全国行动 华为联手上万家伙伴启动第三届828 B2B企业节

华为如何抓住全闪化百亿市场新机遇?

闪存普惠,一步到位 华为正式发布极简全闪数据中心暨伙伴先锋行动

华为发布园区网络“光进铜退”先锋行动 ——将投入5000万元营销资源支持新老伙伴共赢园区数智新未来

华为老将余承东,字典里没有躺平

新商机|新标配|新支持,园区网络光进铜退先锋行动发布会

华为发布星河AI网络解决方案,携手全球伙伴共同倡议加快Net5.5G产业演进发展

华为陈帮华:打造F5G-A高品质运力网,形成“全国一台计算机”