IBM称旗下的Snap机器学习库比TensorFlow快46倍

IBM日前放出话来,说旗下POWER服务器上的机器学习不仅仅是比谷歌云的TensorFlow快而已,而是快了整整46倍。

谷歌软件工程师Andreas Sterbenz今年二月曾发文描述如何利用谷歌云机器学习和TensorFlow进行大规模广告和推荐场景点击预测。

他训练的模型可用来预测Criteo Labs点击日志(http://labs.criteo.com/)上显示广告的点击次数,Criteo Labs点击日志的大小超过1TB,包含来自数百万显示广告的特征值和点击反馈资料。

数据经过预处理(60分钟)后进行实际学习,训练用了60台工作机器和29台参数机器。该模型的训练花了70分钟,评估损失为0.1293。据我们的理解,该数值是准确性的粗略指标。

Sterbenz然后用了不同的建模技术,以获得更好的结果和减少评估损失,这样做花的时间会更长,最后用的模型是一个三期(Epoch)深度神经网络(Epoch指所有训练矢量更新权重的次数),耗时78小时。

IBM对此并不感兴趣,IBM希望证明自己的训练框架在POWER9服务器和GPU上运行时,在基本初始训练方面的性能比谷歌云平台上89台机器还要好。

苏黎世IBM研究中心的Thomas Parnell和Celestine Dunner用了相同的源数据,都是 Criteo Terabyte Click Logs(Criteo TB点击日志),训练样本达42亿个,特征达100万个,用的机器学习模型、逻辑回归都相同,但机器学习库不同。Parnell和Dunner用的是Snap机器学习库(Snap ML)(https://arxiv.org/pdf/1803.06333.pdf)。

他们在四台Power System AC922服务器上用Snap ML进行训练,即是说8个POWER9 CPU和16个Nvidia Tesla V100 GPU。完成时间不是70分钟,而是91.5秒,快了46倍。

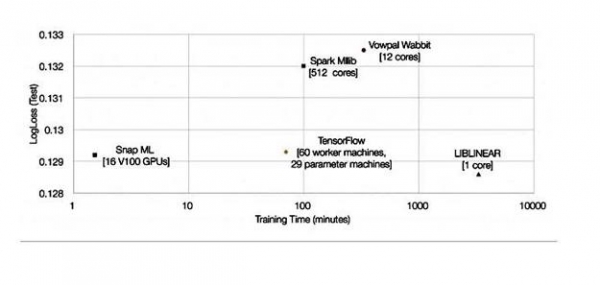

他们给出了一张图表,比较了Snap ML、谷歌TensorFlow和另外三个库的表现:

速度是TensorFlow的46倍,这样的改进是不可小视的。二位研究人员将其归因于什么呢?

他们表示,Snap ML的特点是多层次并行性,可以在集群里不同节点之间分配工作负载,因而可以利用加速器单元,而且还可以利用各计算单元的多核并行性

1、首先,将数据分布到集群中的各工作节点上

2、再将节点上的数据分配到并行运行的CPU和加速GPU上

3、数据再被发送到GPU的多个内核,而CPU工作负载用的是多线程

Snap ML对分层算法功能进行嵌套,以利用三个层级上的并行性。

IBM研究人员并没有说TensorFlow未利用并行性,也没有提供Snap ML和TensorFlowz之间在这方面的比较。

但他们确实提到,“我们实行了专门的解决方案,目的是利用GPU的大规模并行架构,同时又不违背GPU内存中的数据局部性,这样就可以避免大量的数据传输开销。”

他们的文章称,用NVLink 2.0接口的AC922服务器比用接到Tesla GPU的PCIe接口的至强服务器(至强黄金版6150 CPU @ 2.70GHz)要快。 文章表示,“对于基于PCIe的设置,我们测到的有效带宽为11.8GB /秒,对于基于NVLink的设置,我们测到的有效带宽为68.1GB /秒。”

发送到GPU的训练数据就会在GPU里处理。 NVLink系统向GPU发送数据块的速度比PCIe系统快得多,时间为55ms,而不是318ms。

IBM团队还表示,“我们将系统用到的算法在用于稀疏数据结构时做了一些新的优化。”

总的来说, Snap ML似乎可以更多地利用Nvidia GPU,与x86服务器产品的PCIe链接比,在NVLink上可以更快地将数据传给Nvidia GPU。我们不知道POWER9 CPU与Xeons的速度相比时如何;就我们所知,IBM尚未公开发布任何POWER9与Xeon SP直接比较的结果。

我们其实也无法说Snap ML比TensorFlow好了多少,只有在相同的硬件上运行Snap ML和TensorFlow做了比较以后才能见分晓。

无论怎么说,时间缩短了46倍的确令人印象深刻,这样的表现给了IBM推动旗下POWER9服务器很大的空间,POWER9服务器可以成为加插Nvidia GPU运行Snap ML库及进行机器学习的场所。

好文章,需要你的鼓励

Glean年收入突破3亿美元,削减AI成本成核心卖点

企业AI搜索公司Glean宣布年度经常性收入(ARR)达3亿美元,较15个月前的1亿美元增长三倍。尽管谷歌、微软、OpenAI等科技巨头纷纷入局企业AI搜索市场,Glean凭借"上下文图谱"技术深度理解企业业务需求,并帮助客户显著降低AI计算成本。该公司提供按用量计费和混合定价两种模式,客户涵盖Databricks、Reddit、Pinterest及三星等企业。Glean上轮融资后估值达72亿美元。

香港中文大学与MiniMax联手破解AI图像描述的“说多错多、说少漏多“困局

香港中文大学与MiniMax提出ClaimDiff-RL框架,将图像描述的AI训练从整体打分升级为逐条核查,有效解决了传统方式导致AI"少说保平安"的问题,同时在多项基准测试上超越Gemini-3-Pro-Preview。

蓝色起源“新格伦“火箭在佛罗里达测试中发生爆炸

杰夫·贝索斯旗下的蓝色起源公司在佛罗里达卡纳维拉尔角进行静态点火测试时,新格伦重型火箭发生爆炸。这是美国历史上最大规模的火箭爆炸之一,也是蓝色起源公司遭遇的最严重失败。所有人员安全,但该事故可能导致新格伦火箭项目长期暂停。此前该火箭已成功完成三次发射,并实现了助推器回收和重复使用。

NTU、HKU等多所顶校联手,让AI同时“多角度看片“——视频理解的并行探针革命

ParaVT是一个由南洋理工等多校联合提出的并行视频工具调用框架,通过让AI同时分析多段视频并引入PARA-GRPO算法解决训练中的格式崩溃与工具跳过问题,在六项长视频理解测试中平均提升约7.9%。

Glean年收入突破3亿美元,削减AI成本成核心卖点

蓝色起源"新格伦"火箭在佛罗里达测试中发生爆炸

智能体AI正在重塑企业架构与Token经济学

堪培拉理工学院如何借助技术革新重塑课堂教学体验

Gemma 4携手Arm:优化端侧AI,加速移动应用体验

制药公司与初创企业如何携手推动AI落地

《星球大战》导演盛赞生成式AI:电影制作的革命性工具

Salesforce借助Informatica布局企业级无头数据管理架构

几乎所有M5 MacBook Air配置现在都降价近200美元

企业用好Agent,关键不在“买一个智能体”|原点Talk 分享会

大模型评测风向变了,Testin云测如何构建企业级AI质量标尺?

因民事养老金管理失误,英国政府拒绝向Capita授予5.63亿英镑合同